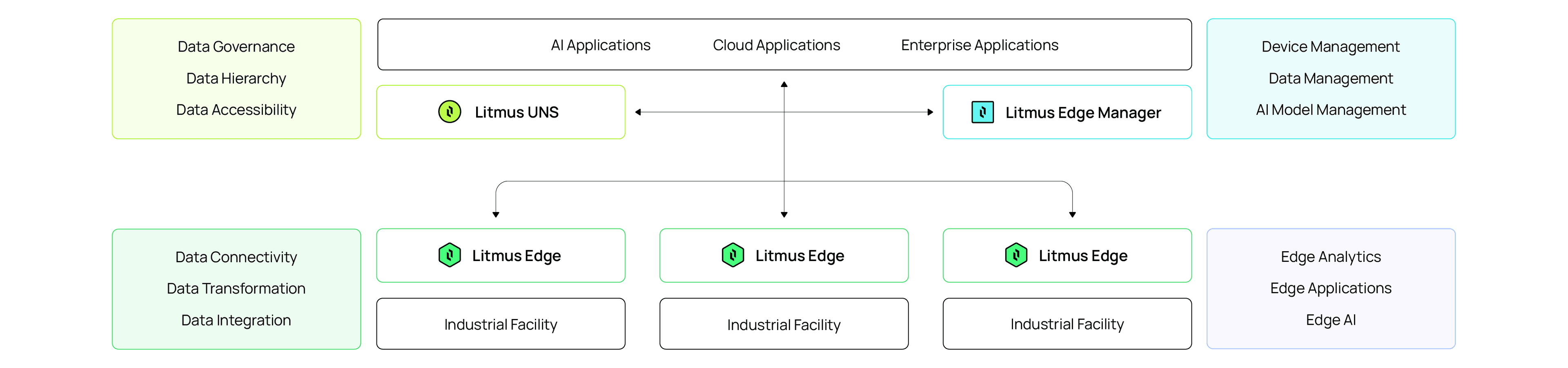

最新のエッジデータプラットフォームとして、リトマスはOTデータの可能性を解き放ち、一貫性、セキュリティ、スピードで産業用AIを強化します。すべての施設に導入し、OT システムと AI アプリケーション間の統一されたデータフローを実現することで、導入の障壁を取り除き、AI をシームレスに拡張します。

リトマスはAIを最も重要な場所、つまりエッジに組み込む。

MCP ServerはAIワークロードをオーケストレーションし、モデルをエッジで即座に展開、更新、実行できるようにします。リトマスは、意思決定が行われる場所でリアルタイムに推論と分析を行うとともに、主要なクラウドAIサービスと統合して、ローカルインテリジェンスと大規模なクラウドモデルを組み合わせることができます。

Nvidia GPUドライバーの最適化されたサポートにより、コンピュータ・ビジョン、AIモデル、その他のGPU集約型AIアプリケーションのローカル・ランタイムがエッジで可能になります。エッジAIランタイムは、ローカライズされたAIユースケースのためにデータをクラウドに送信する必要性を排除します。

Litmus Edge内のローカルにホストされたSLMは、資産知識とトラブルシューティング、プロセスの最適化と改善を中心に設計された多くのユースケースを可能にします。SLM をエッジで実行することで、エアギャップ環境でも機密データを安全に保つことができます。

Litmus は MCP Server と共に、AI エージェントに必要な基盤(過去のコンテキスト、アセットモデル、プロセスインテリジェンス)を提供する構造化された Data & Metadata API を提供します。この組み合わせにより、エージェントは一般的なレコメンデーションを超えて、オペレータが信頼できる正確でコンテキストに富んだガイダンスを提供できるようになります。